【今週のSEO最新ニュース】2026/2/21~2/27のSEO最新情報15個!各要点をわかりやすく紹介

2026年2月第4週のSEO最新情報11個を解説しています。GoogleのAI概要(AIO)がブランド認知に与える影響や、コアウェブバイタルの新指標「INP」導入に伴うFIDの廃止、公式発表のない順位変動の継続などが主なトピックです。AIとの共存を前提とした検索環境の激変に対し、サイト運営者が今取り組むべき具体的な指針が示されています。

- AI概要(AIO)がブランド認知の起点に:AIOでの引用は直接的なクリックだけでなく、ユーザーがブランド名を再検索する「指名検索」の強力なトリガーとなっています。

- コアウェブバイタル指標「INP」が正式導入:応答性を測る新指標INPがFIDに代わり必須項目へ。インタラクティブな要素の改善が、ページ体験評価の分かれ目となります。

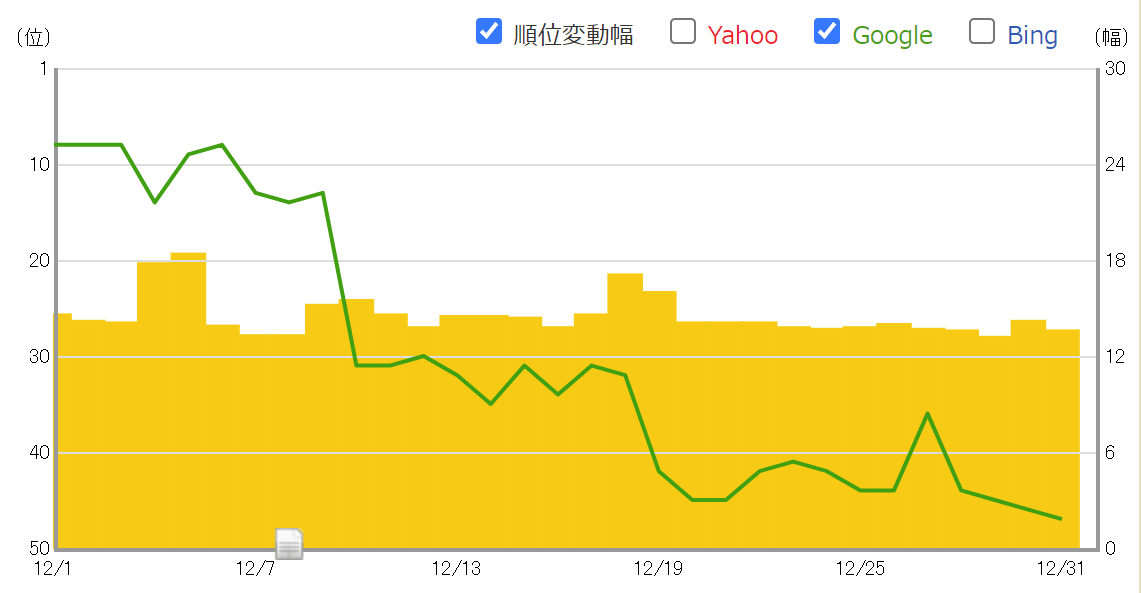

- 2月下旬も続く不安定な検索順位の変動:公式発表はないものの、多くのサイトで乱高下が観測されています。アルゴリズム調整が続く間は、過度な修正を避け静観が必要です。

- AI時代のコンテンツは「実体験」が差別化の鍵:AIが生成可能な一般論ではなく、著者独自の視点や実体験に基づく一次情報こそが、Googleに高く評価される唯一の道です。

- サーチコンソールのAI活用で分析を効率化:新機能のAIチャットを活用し、自然言語でデータ抽出が可能に。複雑なレポート作成を自動化し、戦略立案に時間を割くべきです。

2026年2月21日~2月27日の間に公開されたSEOに関する最新ニュースを15個、ディーボのSEOラボX公式アカウントでポスト(投稿)しました。

これらのポストの要点をそれぞれまとめて、初心者にもわかりやすくSEO最新情報を紹介したいと思います。

- 2026年2月22日付近のGoogleアップデートによる検索への影響が複数報告されてる

- Googleは、手動でのインデックス強制登録を推奨せず、標準的な仕組みの利用を求めている

- Google検索で2月23日に発生した「検索結果が表示されない不具合」は、数時間後に解消済み

- Googleサーチコンソールの「インデックス作成」レポートで2025年12月15日以前のデータが消失中

- Ahrefsのトラフィック推定は中央値で約50%の乖離があるが、競合との比較指標としては非常に優秀

- AI特有の言い回しはエンゲージメントを下げますが、ダッシュ(—)の使用はむしろ好影響

- AI量産アフィサイトは一時稼げるが、Googleのスパムアップデートで確実に排除される

- Googleは、サイトに新規性や重要性がないと判断すれば、サイトマップを利用しない

- 検索インプレッションの急増が、将来の検索順位やサイト評価に悪影響を及ぼすことはない

- Google Discoverは鮮度と画像を重視。不評なサイトはランキング前に除外される仕組み

- 2026年2月のDiscoverコアアップデートにより、ローカル性・即時性が強化され、釣り見出しが排除

- ChatGPT経由の成約率は検索より31%高い。事前に対話で比較を終えた「質の高い客」が流入

- Bingのガイドラインが刷新。CopilotやAPIへの活用が明記され、AI時代への対応を強化

- LLM経由の流入はまだ微増ですが、成約率は約18%と他チャネルを圧倒する極めて高い質を誇る

- Anthropicが3種のクローラーの役割を公開。用途別に収集・検索・学習の拒否設定が可能に

2026年2月22日付近のGoogleアップデートによる検索への影響が複数報告されてる

2026年2月22日付近、Google検索の結果において「ここ10年で最大級」と評される激しい順位変動が報告されました。多くのSEO追跡ツールが異常な数値を記録しており、トラフィックが数時間で8割減少する「崖っぷち」のような急落や、一日に何度も順位が激変する極めて不安定な挙動が観測されています。Googleは2月5日からDiscover専用のコアアップデートを実施していましたが、通常の検索結果に関する公式なアップデート発表はなく、水面下で大規模なアルゴリズム調整が行われた可能性が濃厚です。

現場の報告では、特に「情報の深さ」と「明確な構造」を持つページが評価される一方で、権威性や歴史の浅いサイトが一時的に上位へ押し上げられた後に急落する「シェイク(攪拌)」現象が目立っています。一部では「スパムサイトが目立つ」といった不満も上がっていますが、これはGoogleが新しい品質評価モデルやエンティティ(固有名詞)の関連性をテストしている過程のノイズであるとも推測されます。また、地域性の高いキーワードでの変動も確認されており、情報の鮮度や地域的な専門性がより重視される傾向が強まっています。

結論として、2026年2月の変動は「AI検索への最適化」と「情報の信頼性再評価」が同時並行で進んでいる過渡期特有の混乱と言えます。数時間単位の激しい入れ替わりは、Googleがリアルタイムに近い精度でインデックスの質を再検証している証拠でもあります。サイト運営者は、一時的な順位の乱高下に一喜一憂して無理な修正を加えるのではなく、まずは自身のサイトが「特定のトピックにおいて他にはない深い洞察」を提供できているかを冷静に分析し、データが安定するのを待つ忍耐強さが求められる時期です。

2026年2月22日付近のGoogleアップデートによる検索への影響が複数報告されてる。#Googleアップデート #SEO #SEO対策https://t.co/u0tNro5wkC

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 24, 2026

・トラフィックも収益も過去最低。すべてがかつてないほど悪化しています。…

Googleは、手動でのインデックス強制登録を推奨せず、標準的な仕組みの利用を求めている

Googleのジョン・ミューラー氏は、検索結果へのインデックス登録を「強制」しようとする行為について、強い懸念を表明しました。特に一定以上の規模を持つサイトにおいて、手動でページを一つずつ登録させる戦略は「理にかなっていない」と断言しています。SEO担当者が共有する裏技的な「強制インデックス手法」に頼るのではなく、サイトマップの送信や内部リンクの最適化といった、Googleが推奨する標準的な仕組みを活用すべきだと助言しました。

同氏は、ECサイトなどの特定分野であれば、Search Consoleで無理に登録を迫るよりも、Google Merchant Center(マーチャントセンター)等の専用ツールを利用する方が適切であると指摘しています。また、頻繁に手動リクエストを送らなければならない状況自体が、コンテンツの品質やサイト構造に根本的な問題を抱えているサインである可能性も示唆されました。高品質なサイトであれば、Googleのシステムは自然かつ迅速にページを発見し、インデックスするように設計されています。

結論として、2026年のSEO戦略において「強制インデックス」は持続不可能な手法であり、長期的な評価を下げる要因にもなり得ます。目先の登録速度を追うために不自然な手段を講じるのではなく、Googlebotがスムーズに巡回できるクリーンなサイト設計と、質の高いコンテンツ提供に注力することが本質的な解決策です。システムが自動で価値を認める状態を目指すことが、AI検索時代においても変わらない「インデックス促進」の王道であり、最も確実な近道と言えるでしょう。

Googleは、手動でのインデックス強制登録を推奨せず、標準的な仕組みの利用を求めています。#インデックス登録をリクエスト #サーチコンソール #SEOhttps://t.co/4wbZ75Y0Os…

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 24, 2026

Google検索で2月23日に発生した「検索結果が表示されない不具合」は、数時間後に解消済み

Googleは、2026年2月23日に一部の検索結果が正常に表示されなくなっていた「配信の問題」が完全に解消されたことを発表しました。この不具合により、一部のユーザーの間で検索結果ページが空になったり、特定の情報が表示されなかったりする現象が相次いで報告されていました。Googleは同日午前に公式に調査を開始したことを認め、問題の特定からわずか数時間という迅速さで修正を完了させています。

Googleの公式ダッシュボードによれば、今回のトラブルは検索エンジン側のシステムに起因するものでした。そのため、個別のウェブサイトの品質評価やランキングの低下、あるいはペナルティといった要因とは一切関係がありません。不具合が発生していた数時間の間、Search Consoleのクリック数やインプレッション数が一時的に落ち込んだ可能性がありますが、現在は全ユーザーに対して正常な検索結果が提供されています。

結論として、2026年2月23日のアクセスデータに不可解な急落が見られる場合、それはサイト側の不備ではなくGoogleのシステム障害が原因と考えられます。サイト運営者が特別な対応を行う必要はなく、ランキングへの長期的な影響も懸念されていません。激しい変動が続く時期ではありますが、今回の件についてはGoogle側の修正を信頼し、冷静に通常の運用を継続して問題ないでしょう。もしデータの欠落が続く場合は、改めて自社の設定を点検することが推奨されます。

Google検索で2月23日に発生した「検索結果が表示されない不具合」は、数時間後に解消済み。#Google検索 #検索結果 #SEOhttps://t.co/0Pc5GfKTkw

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 25, 2026

※Googleは、2026年2月23日(米国時間)に一部の検索結果が正常に表示されなくなっていた「配信の問題(Serving…

Googleサーチコンソールの「インデックス作成」レポートで2025年12月15日以前のデータが消失中

Google Search Consoleの「ページ インデックス作成」レポートにおいて、2025年12月15日以前のデータが消失する不具合が発生しています。現在、多くのユーザーの管理画面で当該期間のデータが白紙となっており、広範囲にわたるシステムバグである可能性が濃厚です。Googleのジョン・ミューラー氏は、この現象が12月初旬に発生したデータ遅延問題の副作用であると述べており、個別のサイトに対するペナルティではありません。

この問題により、インデックス状況の長期的な推移や過去の施策効果の検証が一時的に困難となっています。データが抜け落ちている期間については、分析やレポート作成を一旦保留し、Google側による復旧を待つしかありません。すべてのユーザーが同様の影響を受けているため、自サイト固有のエラーを疑って設定変更などの過度な対応を行う必要はありません。現在はGoogleが修正を進めている段階であり、数日中にデータが再表示されるのを待つのが賢明です。

結論として、今回のデータ消失はGoogleの内部システムに起因する一時的な表示トラブルです。2026年3月現在、インデックス分析を行う際は12月中旬以降の数値に焦点を当て、それ以前の比較が必要な場合は復旧を待ってから再開すべきでしょう。サイト運営者は冷静に状況を見守り、公式なアナウンスやデータの回復を確認してから、改めて長期的なインデックス戦略の評価を行うことが推奨されます。Googleのインフラ側の問題であるため、慌てずに対処することが重要です。

Googleサーチコンソールの「インデックス作成」レポートで2025年12月15日以前のデータが消失中。#ページインデックス登録レポート #サーチコンソール #SEOhttps://t.co/D3sp4xQlOe

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 24, 2026

※Google Search Console(GSC)の「ページ… pic.twitter.com/zkNwo1FxRG

Ahrefsのトラフィック推定は中央値で約50%の乖離があるが、競合との比較指標としては非常に優秀

Ahrefsが自社の検索トラフィック推定精度を1,635サイトの実データと比較調査した結果、中央乖離率は49.52%であることが判明しました。ツールの数値は実トラフィックの約半分、あるいは2倍程度の誤差を含むのが一般的ですが、競合ツールのSEMrushが記録した68.36%に比べると、相対的に高い精度を維持しています。この誤差は、全キーワードの網羅の難しさや、CTR予測の限界といった外部ツール特有の制約に起因するものです。

一方で、実データとの相関係数は0.76と高く、データの整合性は極めて優秀であることが証明されました。これは、数値の絶対値にズレがあっても「AサイトがBサイトより多い」という相対的な優劣や、トラフィックの増減傾向を把握する上では非常に信頼できることを意味します。つまり、Ahrefsは単体で正確なアクセス数を測るためのものではなく、ライバル比較や市場のトレンド分析において真価を発揮するマーケティングツールと言えます。

さらに記事では、自社の実数値を用いて競合のトラフィックをより正確に導き出す補正式が提案されています。競合の推定値に「自社の実数値と推定値の比率」を掛け合わせることで、業界特有の偏りを排除した精密な予測が可能になります。2026年のSEO戦略では、ツールの数値を盲信するのではなく、自社データを基準とした相対的な分析軸を持つことが重要です。高い整合性を誇るAhrefsのデータを賢く活用し、確かな意思決定へと繋げましょう。

Ahrefsのトラフィック推定は中央値で約50%の乖離があるが、競合との比較指標としては非常に優秀。#ahrefs #検索トラフィック #SEOhttps://t.co/bUpsgETwIY

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 25, 2026

※Ahrefsが自社の検索トラフィック推定データの精度について、1,635サイトのGoogle Search…

AI特有の言い回しはエンゲージメントを下げますが、ダッシュ(—)の使用はむしろ好影響

Search Engine Landの調査により、AI特有の文章の「癖」が読者のエンゲージメントに与える影響が明らかになりました。最もネガティブな影響を与えたのは「結論(Conclusion)」という見出しで始まる定型的な締めくくりです。このような型にはまった構成は、読者に内容の薄さを予感させ、離脱を招く強い要因となります。また「〜だけでなく〜も」といった強調構文の多用も、不自然な印象を与えて直帰率を高める傾向があるため注意が必要です。

一方で、エムダッシュ(—)の使用は意外にもエンゲージメント率と正の相関を示しました。SNS等ではAI特有の表現として忌避されがちですが、適切に補足説明を加える文章は、短く断定的な文よりも内容が豊かで熟考された印象を読者に与えます。AIチェッカーの判定に過剰反応して機械的に修正するよりも、文脈に合った句読点を使いこなし、読者にとっての「明快さ」と「有用性」を追求することこそが、現代のコンテンツ制作において重要です。

結論として、AIを執筆に活用する際は、数式のような決まり文句が読者体験を損なっていないかを精査すべきです。形式的なまとめで終わらせるのではなく、独自の分析や新しい価値を付け加えることで、人間らしい深い洞察を提供することがエンゲージメント維持の鍵となります。2026年のSEOライティングでは、AIらしさを消す技術よりも、読者の知的好奇心を満たし、次の行動へ導く「人間中心の編集力」がこれまで以上に価値を持つでしょう。

AI特有の言い回しはエンゲージメントを下げますが、ダッシュ(—)の使用はむしろ好影響です。#AIライティング #エンゲージメント #SEOhttps://t.co/yyC34Q9o2s

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 26, 2026

※Search Engine…

AI量産アフィサイトは一時稼げるが、Googleのスパムアップデートで確実に排除される

Search Engine LandによるSEO実験は、AIで量産したアフィリエイトサイトが短期的には稼げても、最終的にはGoogleに排除される実態を浮き彫りにしました。実験では、信頼性指標を一切排除し、AIと公開データのみで数千ページを自動生成したサイトを構築しました。初期段階では順位が急速に上昇し成長を見せましたが、直後のスパムアップデートにより、アクセスは一瞬でゼロになるという壊滅的な結果を招いています。

Googleは、これらのサイトを「検索結果を操作するためだけに作られた価値の低いコンテンツ」と正確に判定しました。この結果は、AIによる自動量産がもはや持続可能な戦略ではないことを証明しています。2026年のSEOにおいて重要なのは、ページ数で勝負することではなく、AIには模倣できない独自の調査や実体験に基づいた「真似できない資産」の構築です。検索エンジンへの依存を減らし、SNSやコミュニティ等の多角的な集客経路を持つことも不可欠です。

結論として、今後は「ペナルティを避ける」消極的な姿勢ではなく、ユーザーの課題を深く解決する「思考のリーダー」としての価値確立が求められます。AIを効率化のツールとして活用しつつ、最終的には人間ならではの深い洞察と信頼という土台を築くことが、生き残るための唯一の道です。2026年の勝者は、AIが溢れる情報の海の中で、実体験に裏打ちされた唯一無二の価値を提供し続け、検索以外の場所でも選ばれるブランドを構築したサイトになるでしょう。

AI量産アフィサイトは一時稼げるが、Googleのスパムアップデートで確実に排除される。#AIアフィリエイト #スパムアップデート #SEOhttps://t.co/kPEhedyusJ

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 27, 2026

※Search Engine…

Googleは、サイトに新規性や重要性がないと判断すれば、サイトマップを利用しない

Googleのジョン・ミューラー氏は、サイトマップの有効性がコンテンツの価値に依存していることを改めて強調しました。同氏によれば、Googleがサイトマップを利用するためには、そのサイト内にインデックスすべき新規性や重要性のある情報が含まれていると判断される必要があります。もしサイト全体の評価が低く、新しいコンテンツに価値がないと見なされた場合、たとえ正確なサイトマップを提供していても、Googleはそれをクロール対象から外してしまいます。

サイトマップはクロールを補助する有用なツールに過ぎず、そこにURLを記載したからといって全ページのインデックス登録を保証するものではありません。Googleはインターネット上の全情報を登録するわけではなく、サイトの品質に応じてリソースを配分しています。クロール頻度の低下はあくまで「価値不足」という根本的な問題から生じる一つの症状であり、サイトの構造改善や表示速度の向上だけでなく、コンテンツが持つ独自の見解や専門性の強化が解決には不可欠です。

結論として、2026年のSEO戦略において、サイトマップを「魔法の杖」のように過信するのは危険です。最も重要なのは、Googleに「このサイトは頻繁に巡回して新しいページを登録する価値がある」と認めさせるような、高品質な情報発信を継続することです。技術的な整備は土台として必要ですが、最終的にはユーザーの課題を解決する唯一無二の価値を提供し続けることが、インデックス登録を促進し、検索結果での視覚性を維持するための最も確実な近道と言えるでしょう。

Googleは、サイトに新規性や重要性がないと判断すれば、サイトマップを利用しません。#サイトマップ #インデックス登録 #SEOhttps://t.co/ydEcbmbyvW…

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 24, 2026

検索インプレッションの急増が、将来の検索順位やサイト評価に悪影響を及ぼすことはない

Googleのジョン・ミューラー氏は、サーチコンソールにおける表示回数の急増が、将来の検索順位やサイト評価に悪影響を与えることはないと明言しました。あるサイト運営者が、特定クエリでの露出急増がスパム判定やランキング低下を招くのではないかと懸念を示したことに対し、同氏は「そのようなスパイクが検索上の問題を引き起こすことはない」と回答しています。一時的な数値の変動はトピックのトレンド化などで自然に発生するものであり、Googleのアルゴリズムがこれをネガティブな兆候と捉えることはありません。

インプレッションの増加に伴い「平均掲載順位」の数値が下がるように見えることがありますが、これは単に表示される範囲が広がり、これまで圏外だったクエリでも露出が始まった結果に過ぎません。実質的なキーワード順位が低下したわけではないため、見かけ上の数値の変化に惑わされないことが重要です。Googleは表示回数の急増を「不自然な操作」や「低品質の兆候」と見なすことはなく、サイト全体の品質評価が損なわれる心配も無用であるとアドバイスしています。

結論として、2026年のSEO運用においても、一時的な露出の急増は冷静に捉えるべき現象です。急激な流入の変化はコンテンツが市場のニーズに合致した証拠であり、むしろチャンスとして活用すべきポジティブなシグナルと言えます。平均順位が悪化したように見えても、それが広範囲な露出による副作用であることを理解し、本来のターゲットキーワードでの順位が維持されているかを確認しましょう。数値の変動に一喜一憂せず、質の高いコンテンツ提供を継続することが、長期的な信頼構築への唯一の道です。

検索インプレッションの急増が、将来の検索順位やサイト評価に悪影響を及ぼすことはありません。#表示回数 #サーチコンソール #SEOhttps://t.co/Aiqdw9Dyec

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 24, 2026

Googleのジョン・ミューラー氏が、Google Search…

Google Discoverは鮮度と画像を重視。不評なサイトはランキング前に除外される仕組み

Google Discoverは、最新の調査により鮮度と視覚情報を極めて重視する多段階の選別プロセスを持っていることが判明しました。フィード生成は9段階のパイプラインで行われ、特筆すべきは「ユーザーによるブロック」の判定がランキングの前に行われる点です。一度でもユーザーから「表示しない」と選択されると、そのドメインのコンテンツは評価の土俵にすら上がれなくなるため、初期段階での信頼構築が不可欠です。

露出の鍵を握るのは公開からの経過時間で、特に最初の7日間は強力なブーストがかかりますが、15日を過ぎるとエバーグリーンな内容を除き急激に表示が減少します。また、画像サイズには厳格な要件があり、幅1200px以上の高解像度画像と「max-image-preview:large」の設定が、クリック率を最大45%向上させるための必須条件です。不適切なメタタグの設定は、コンテンツがどれほど優れていてもDiscoverから除外される原因となります。

結論として、Discoverでの成功は「高画質な視覚要素」「最新のトピック」「ユーザーに拒否されない誠実さ」の三原則に集約されます。2026年2月に実施されたDiscover専用のコアアップデートでは、地域性や専門性がより厳格に評価されるようになり、クリックベイト的な手法は排除される傾向が強まりました。単なる集客テクニックに頼るのではなく、ターゲット層が「また読みたい」と感じる質の高い体験を提供し続けることが、安定したトラフィック獲得への唯一の道です。

Google Discoverは鮮度と画像を重視。不評なサイトはランキング前に除外される仕組みです。#Discover #ランク付け #SEOhttps://t.co/EccSsoujcE

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 26, 2026

※Google…

2026年2月のDiscoverコアアップデートにより、ローカル性・即時性が強化され、釣り見出しが排除

2026年2月に実施された「Discoverコアアップデート」の分析により、Googleがフィードのパーソナライズと質の向上を劇的に進めた実態が明らかになりました。最大の変化はローカル性の強化で、ユーザーの居住地域に根ざしたメディアが表示される割合が約5倍に増加しています。これにより、全国規模の汎用的なニュースよりも、特定の州やコミュニティに密着した情報が強力な露出機会を得るようになりました。米国外のサイトが米国内フィードに表示されるシェアは低下し、地域情報の重要性が決定定的となっています。

また、扇情的な表現でクリックを誘う「釣り見出し」への対策が強化され、テンプレート化された低品質なリスト記事の視認性が大幅に低下しました。一方で、記事タイトルの平均文字数は増加し、内容を正確かつ誠実に伝える見出しが好まれる傾向にあります。最新のトピックやスポーツ、ニュースといった「即時性」のあるカテゴリのシェアも拡大しており、専門知識に基づいた独自性のあるコンテンツが、Googleのシステムによってトピックごとに厳格に評価されるようになりました。

結論として、2026年のDiscover攻略には、地域密着度と深い専門性の掛け合わせが不可欠です。小手先のテクニックは排除され、X(旧Twitter)の投稿が公式メディアの補完として表示されるなど、流入経路の多様化も進んでいます。パブリッシャーは、テンプレートに頼った量産体制から脱却し、今まさに読者が求めている「実用的でタイムリーな洞察」を提供しなければなりません。ユーザーに拒否されず、信頼される情報源として「トピックごとの権威性」を積み上げることが、安定したトラフィックを維持するための唯一の正攻法です。

2026年2月のDiscoverコアアップデートにより、ローカル性・即時性が強化され、釣り見出しが排除。#Discoverコアアップデート #Googleアップデート #SEOhttps://t.co/fgllhEDzZj

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 24, 2026

※NewzDash社によるデータ分析に基づき、2026年2月に実施された「Google Discover…

ChatGPT経由の成約率は検索より31%高い。事前に対話で比較を終えた「質の高い客」が流入

Visibility Labsが2025年の1年間で94のEコマースサイトを分析した結果、ChatGPT経由のトラフィックは非ブランド検索より31%高い成約率を記録しました。具体的な数値として、ChatGPT経由のコンバージョン率は1.81%に達し、一般的な検索経由の1.39%を大きく上回っています。これは、ユーザーがAIとの対話を通じて商品の比較や絞り込みを事前に終えているため、流入時点で既に購入意向が固まっている「意図の凝縮」が起きているためです。

ChatGPTからの流入数は2025年を通じて10倍以上に急増しましたが、総収益に占める割合は依然として1.5%程度に留まっています。また、平均注文額(AOV)は検索経由より約14%低い204ドルとなっており、現時点では主要な収益源というよりも「成約効率の極めて高い新チャネル」としての側面が際立っています。さらに、ChatGPTで情報を得た後に改めてブランド名で検索し直すユーザーも多いため、GA4等の数値以上に実際のブランド貢献度は高いと考えられます。

結論として、2026年のEコマース戦略では、AIチャットを単なる要約ツールではなく「質の高い見込み客を運ぶ紹介エンジン」と捉えるべきです。流入のボリュームこそ検索には及びませんが、購入直前のユーザーを確実に捉えるGEO(生成AI最適化)の重要性は増しています。自社製品がAIの回答内でどう推奨されるかを意識し、対話の過程で信頼を獲得するコンテンツ作りが、広告費に頼らずに高効率な成約を生むための新たな鍵となるでしょう。

ChatGPT経由の成約率は検索より31%高い。事前に対話で比較を終えた「質の高い客」が流入。#ChatGPT #CVR #SEOhttps://t.co/BSk72XAgq9

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 27, 2026

※Visibility Labsが2025年の12ヶ月間にわたり、94のEコマースサイトを分析した調査結果をまとめています。

1. 驚異的なコンバージョン率(CVR)…

Bingのガイドラインが刷新。CopilotやAPIへの活用が明記され、AI時代への対応を強化

MicrosoftはBingウェブマスターガイドラインを刷新し、AI時代の検索環境に即した新基準を明文化しました。最大の変更点は、ガイドラインの適用範囲が従来の検索エンジンだけでなく、AIチャットの「Copilot」やAIの回答根拠を支える「グラウンディングAPI」にまで拡張されたことです。これにより、ウェブサイトが提供する情報は、単なる検索結果の一覧としてだけでなく、AIがユーザーと対話する際の重要な知識源として公式に位置づけられることになりました。

新ガイドラインでは、遵守によるメリットがより明確に定義されています。適切な対策を講じることで、検索順位の維持のみならず、AIの回答内での引用や参照を獲得し、質の高いトラフィックを安定的に確保できることが強調されました。一方で、規約違反があった場合には、検索結果からの除外に留まらず、AIによる回答対象からも完全に排除されるリスクが警告されています。これは、AI時代においても「信頼性と品質の確保」がサイト存続の絶対条件であることを示しています。

結論として、今回の更新はMicrosoftが「検索」を「AIのための情報源」として再定義する姿勢を象徴しています。サイト運営者にとっては、従来のSEOがそのままAIからの送客を勝ち取るためのGEO(生成AI最適化)に直結することが改めて確認されました。デザインもモダンに刷新された新しいガイドラインを指針とし、検索とAIチャットの双方から評価される「質の高いコンテンツ提供」を継続することが、2026年以降のデジタルマーケティングにおける成功への最短ルートとなります。

Bingのガイドラインが刷新。CopilotやAPIへの活用が明記され、AI時代への対応を強化。#Bingウェブマスターガイドライン #SEO #SEO対策https://t.co/gdg1U3aeeI

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 27, 2026

※MicrosoftがBingウェブマスターガイドラインを更新し、デザインの刷新とともに、AI時代に合わせた内容の変更を行いました。

1.…

LLM経由の流入はまだ微増ですが、成約率は約18%と他チャネルを圧倒する極めて高い質を誇る

Search Engine Landが2025年から13ヶ月間にわたるデータを分析した結果、LLM(大規模言語モデル)経由のトラフィックは極めて高い成約率を誇ることが判明しました。全流入に占めるLLM経由の割合は平均2%未満とまだ少数ですが、その成長速度は凄まじく、2025年下半期には平均で80%の増加を記録しています。特筆すべきはコンバージョン率の高さで、SEOやリスティング広告などの主要チャネルを大きく上回る約18%という驚異的な数値を叩き出しました。

この極めて高い成約率の背景には、ユーザーがLLMとの対話を通じて既に疑問を解決し、購入意思を固めた「最終確認段階」でサイトを訪れるという独特のユーザー行動があります。また、LLMが回答の根拠として引用するソースにも変化が見られ、直近ではYouTube動画の引用が増加傾向にある一方、以前勢いのあったRedditは横ばいとなっています。どのプラットフォームが引用されやすいかを把握し、AIが参照しやすい「権威ある情報」を配置することが、今後のデジタルマーケティングの成否を分けるでしょう。

結論として、2026年現在のLLMトラフィックは「量」こそ限定的ですが、その「質」において他を圧倒する戦略的シグナルへと進化しました。サイト運営者は単なる流入数に一喜一憂するのではなく、LLM経由のユーザーがどのページに着地し、どのような課題を解決しているかを詳細に分析すべきです。AIに要約・引用されるための「GEO(生成AI最適化)」を強化し、高意図なユーザーを確実にコンバージョンへ導く専用の導線設計を整えることが、次世代の検索市場で先行利益を得るための最善策となります。

LLM経由の流入はまだ微増ですが、成約率は約18%と他チャネルを圧倒する極めて高い質を誇ります。#LLM #CVR #SEOhttps://t.co/kOiluLYgGY

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 27, 2026

※Search Engine Landによる、2025年1月から13ヶ月間にわたる大規模言語モデル(LLM)経由のトラフィック分析結果のまとめです。

1.…

Anthropicが3種のクローラーの役割を公開。用途別に収集・検索・学習の拒否設定が可能に

AnthropicはAI「Claude」に関連するクローラーの仕様を更新し、役割の異なる3種のボットを明確に定義しました。AIモデルの学習と改善を担う「ClaudeBot」、ユーザーの指示でリアルタイムにページを読み取る「Claude-User」、そして検索回答の精度を高めるインデックス作成用の「Claude-SearchBot」に分かれています。これによりサイト運営者は、学習は拒否しつつ検索結果には表示させるといった、用途に応じた精細なアクセス制御が可能になりました。

これらのボットは標準的なrobots.txtの指示を尊重するため、特定のエージェントを指定して拒否設定を行えます。例えば「Claude-SearchBot」をブロックすると、Claudeの検索回答内での露出や情報の正確性が低下するリスクがある一方、ブランド保護のために学習のみを制限する選択も容易です。なお、IPアドレスによるブロックはrobots.txtの読み取り自体を妨げる恐れがあるため推奨されておらず、業界標準のテキストベースによる制御が推奨されています。

結論として、Anthropicの今回の透明性向上は、AIとウェブエコシステムの共存を促す重要な一歩です。運営者は自サイトのコンテンツがAIにどう利用されるかを主体的に判断し、露出の機会と著作権保護のバランスを戦略的に管理することが求められます。2026年のSEO戦略においては、GoogleやOpenAIに加え、Anthropicの各ボットに対しても個別の制御方針を定め、AIチャット経由の「質の高い流入」を維持しながら自社の知的財産を守る体制を整えるべきでしょう。

Anthropicが3種のクローラーの役割を公開。用途別に収集・検索・学習の拒否設定が可能に。#Anthropic #アンソロピック #SEOhttps://t.co/WikVEqrD9q

— 株式会社ディーボのSEOラボ@SEO対策 (@seolabo85) February 26, 2026

※Anthropicが、AI「Claude」に関連するボットのクローリング仕様を更新し、各ボットの役割とブロック方法を明確にしました。

1.…

SEO対策しても検索順位が上がらない…なぜ?

SEO対策しても検索順位が上がらない…なぜ?

検索順位が上がらない理由は、SEO対策の質が低いからです。

例えば、ユーザーの検索意図を無視したり、関連性の低いコンテンツを増やす、内部リンクの最適化など疎かにします。

この場合、SEO対策の質が下がります。

そうなれば、ページやサイト自体の品質が上がらないので、Googleに評価されづらくなります。

結果、検索順位が上がらないというわけです。

こうした悪い状況を回避する為に、サイトの欠点を調査して上位化に必要な対策をご案内します(無料)。

- « 前の記事

【今週のSEO最新ニュース】2026/2/14~2/20のSEO最新情報18個!各要点をわかりやすく紹介 - 次の記事 »

検索順位を上げたり、検索流入を増やすにはSEOが重要!